Impulsando la era de la inferencia en la IA

Impulsando la era de la inferencia en la IA

La inteligencia artificial está transformando la economía global. Además, está impulsando un aumento considerable en la demanda energética y desencadenando una carrera mundial por construir centros de datos a una escala sin precedentes. Sin embargo, dentro de los centros de datos, no todas las cargas de trabajo de IA son iguales, una distinción que tiene importantes implicaciones para el futuro del sector.

Donde la IA se encuentra con el mundo real

Las cargas de trabajo de la IA se dividen en dos categorías principales: entrenamiento e inferencia. El entrenamiento consiste en que los modelos aprenden analizando grandes conjuntos de datos para identificar patrones, relaciones y lógica. Requiere muchos recursos y suele realizarse en grandes centros de datos centralizados. La inferencia se produce cuando el modelo entrenado se aplica a tareas del mundo real. Cada vez que la IA responde a una solicitud, se está realizando inferencia.

La inferencia es la parte de la IA con la que la mayoría de las personas interactúan directamente. Es la carga de trabajo que impulsa los resultados de búsqueda, los asistentes de voz y los sistemas agentivos emergentes que operan de forma autónoma. A medida que se desarrollan nuevas aplicaciones y se expande la base de usuarios de la IA, el volumen de solicitudes de inferencia sigue creciendo rápidamente. Este cambio hace que la inferencia sea cada vez más importante para los operadores de IA en los próximos años. McKinsey prevé que la inferencia se convertirá en la carga de trabajo dominante de la IA para 2030. Mientras tanto, Grand View Research espera que el mercado global de inferencia de IA se duplique con creces en ese mismo período, pasando de 113.500 millones de dólares en 2025 a 253.750 millones de dólares.

.png)

El próximo cambio en la infraestructura de IA

El auge de la inferencia está impulsando la infraestructura de IA hacia una nueva dirección. A medida que aumenta la demanda, necesitamos más recursos para ejecutar estas cargas de trabajo y mayor capacidad de procesamiento para soportarlas. Se prevé que la creciente adopción de la IA genere un aumento global del 255 % en la demanda energética de los centros de datos de IA para 2030. Sin embargo, la mayor parte de la infraestructura actual se diseñó para el entrenamiento, que implica tareas largas y computacionalmente intensivas que se ejecutan en grandes instalaciones centralizadas. La inferencia funciona de manera diferente. A medida que la inferencia continúa escalando, el contraste entre la infraestructura optimizada para entrenamiento y la optimizada para inferencia se vuelve más evidente.

.png)

Satisfacer las exigencias de la inferencia a gran escala requiere un enfoque diferente de la infraestructura. Esto implica diseñar sistemas que optimicen el coste, la velocidad, la fiabilidad y la seguridad, adaptándose a la vez a la volatilidad de la demanda de carga de trabajo. Creemos que estas prioridades impulsarán una transición hacia centros de datos de borde descentralizados.

Costo: Cada inferencia tiene un costo cuantificable en energía y capacidad de cómputo. Este costo suele expresarse como costo por token, la unidad fundamental de datos que procesa un modelo. Reducir este costo determina la cantidad de inteligencia que una empresa puede generar. Ubicar la inferencia cerca de fuentes de energía de bajo costo y optimizar el uso del hardware son algunas de las principales estrategias para lograr esa eficiencia.

Velocidad: Ejecutar la inferencia cerca del lugar donde se generan los datos reduce drásticamente la latencia, lo cual es esencial para aplicaciones como la defensa y la atención médica.

Fiabilidad: Los modelos localizados proporcionan un 30 % más de valor contextual que los modelos globales, superándolos en aplicaciones como la educación, el cumplimiento legal y los servicios públicos. Los sistemas perimetrales también pueden mantener las operaciones durante interrupciones de la red o la nube.

Seguridad: Mantener los datos en el perímetro minimiza el riesgo de exponer datos privados a redes externas, lo cual es esencial para gobiernos, empresas y muchos otros sectores que manejan información sensible.

Volatilidad: Las cargas de trabajo de inferencia pueden ser muy variables e impredecibles. Dado que los usuarios buscan información inmediata, la demanda puede cambiar rápidamente, provocando picos o caídas repentinas en el consumo de energía.

La naturaleza impredecible e inflexible de la inferencia plantea desafíos para su integración en la red eléctrica. Un estudio de la Universidad de Duke reveló que, si las cargas de trabajo se diseñaran con mayor flexibilidad, la red eléctrica actual de EE. UU. ya podría satisfacer la mayor parte del aumento proyectado en la demanda de centros de datos de IA hasta 2029. El problema no radica en la escasez de energía, sino en la coordinación. Para aprovechar todo el potencial de la red actual, se requiere una infraestructura más inteligente que pueda ajustar las cargas de trabajo de cómputo a la energía disponible en tiempo real.

La infraestructura modular y con eficiencia energética desempeñará un papel fundamental en la próxima era de la computación. Aquí es donde MARA vislumbra una ventaja estratégica. Cuando la energía y el cómputo se coordinan en una sola plataforma, el costo por token disminuye y la utilización aumenta. Al controlar tanto la energía como el cómputo, MARA transforma la energía de una limitación en una ventaja que impulsa la inferencia a gran escala.

Visión de MARA: Una plataforma de infraestructura digital diseñada para el valor y la inteligencia.

«Nuestra misión es aprovechar enormes volúmenes de energía de bajo coste y canalizarlos hacia sus usos más productivos, ya sea la minería de Bitcoin, donde la flexibilidad de carga es fundamental, o la IA, donde el menor coste por token es clave». — Fred Thiel, Carta a los accionistas del tercer trimestre de 2025

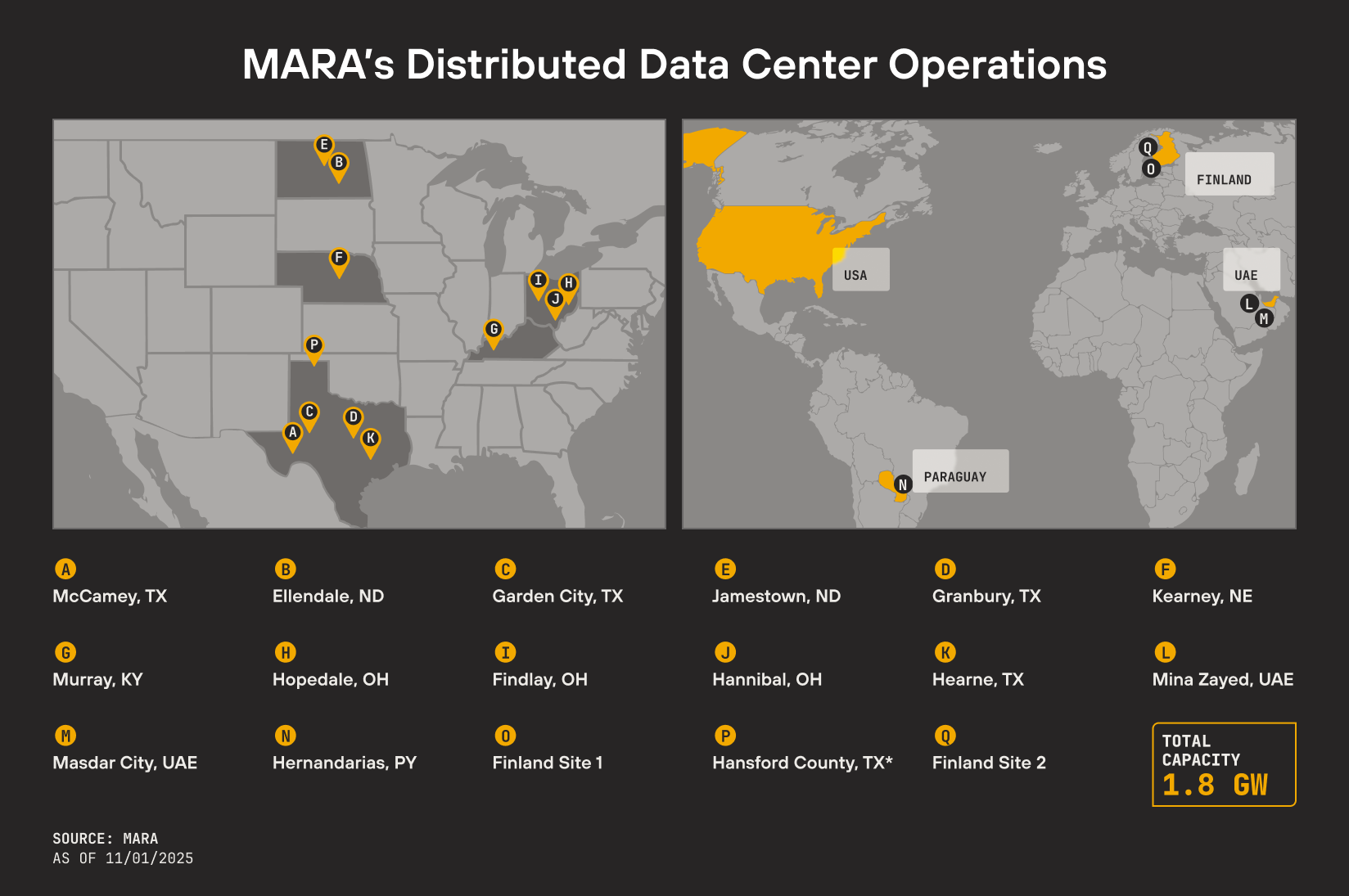

La infraestructura de MARA es idónea para el futuro de la inferencia de IA. Nuestra plataforma se diseñó para computación de alta eficiencia, con una infraestructura que incluye parques eólicos y centrales eléctricas de gas de bajo coste en el borde de la red. Ya gestionamos estos sistemas con flexibilidad, adaptando las cargas de trabajo para utilizar energía de bajo coste o inyectar energía a la red cuando la demanda es alta. Con una capacidad total de 1,8 gigavatios bajo control y en constante crecimiento, creemos que la misma energía que alimenta la minería de Bitcoin es igualmente capaz de soportar la inferencia a gran escala.

翻译结果

翻译结果

Mientras que otras empresas del sector están adaptando sus instalaciones existentes para alquilar GPU para cargas de trabajo de entrenamiento de IA, nosotros priorizamos la inferencia, ya que creemos que es ahí donde podemos generar el mayor valor. Estamos diseñando instalaciones de inferencia modulares y específicas, integradas directamente con energía de bajo coste. Esta infraestructura está diseñada para la próxima generación de computación inteligente. El despliegue de racks de inferencia de IA en nuestro centro de datos de Granbury, Texas, representa un claro avance en esa dirección.

El acuerdo de inversión de MARA en Exaion y nuestra colaboración anunciada con MPLX fortalecen ambos pilares de nuestra plataforma: energía y computación. Nuestra colaboración con MPLX consolida nuestra estrategia energética al integrar la generación de gas natural de bajo coste directamente en los nuevos campus de centros de datos. En cuanto a la computación, nuestro acuerdo de inversión para adquirir una participación mayoritaria en Exaion nos proporciona experiencia de nivel empresarial en infraestructura de IA, nube segura e inferencia. Estos esfuerzos aceleran nuestro objetivo de desplegar centros de datos seguros, eficientes y optimizados para IA a gran escala.

Nuestra estrategia de inferencia abarca todo el espectro de infraestructuras, desde grandes centros de datos con eficiencia energética optimizada, como los de Texas, hasta entornos altamente localizados y seguros, como los de Exaion en Europa. Por un lado, los centros de MARA están diseñados para ofrecer escalabilidad, eficiencia y el menor coste por token; por otro, las implementaciones de Exaion acercan la computación al cliente, priorizando la confianza, el cumplimiento normativo y la localización de los datos.

De la energía a la inteligencia: ¿Qué sigue?

“Creemos que los electrones son el nuevo petróleo y que la energía se está convirtiendo en el recurso clave de la economía digital”. - Fred Thiel, Carta a los accionistas del tercer trimestre de 2025

La IA marca la siguiente fase en la monetización de la energía. Pronto, cada unidad de energía se medirá no solo en megavatios generados, sino también en inteligencia producida. MARA está creando una plataforma donde la energía, la computación y la flexibilidad se combinan para impulsar la inteligencia. El futuro de la infraestructura no es centralizado ni especulativo. Es inteligente, distribuido y ya está en construcción.

Lea sobre el acuerdo de inversión de MARA para adquirir una participación mayoritaria en la empresa de IA Exaion aquí.

Lea sobre el acuerdo de inversión de MARA para adquirir una participación mayoritaria en la empresa de IA Exaion aquí.